Wenn Hoffnungen, Erwartungen und Routinen die Schiffsführung bestimmen. Überlegungen am Beispel des Seeunfalls der »Cosco Busan« von Diethard Kersandt

1. Einführung

In der HANSA (Hefte 10/2008, 10/2009 und 11/2009) setzte sich der Verfasser mit[ds_preview] dem Seeunfall des Containerschiffes »Cosco Busan« (Berührung eines Pfeilers der San Francisco Bay Bridge am 7. November 2007) auseinander. Ausführliche Untersuchungen sind in [6] und [7] niedergelegt. Nicht immer ist der Verfasser der Ursachenermittlung und den Schlussfolgerungen des National Transportation Safety Board (NTSB) der USA gefolgt. Ursächlich dafür war vor allem die vorschnelle Klassifizierung der Ursachen in die bekannte Kategorie ›menschliches Versagen‹. Paul Rogers formulierte das Problem in seinem Beitrag vom 13. November 2007 für die »Oakland Tribune« wie folgt: »The 100 million $ question is why did he choose to turn when he did?« [8]

Diese Frage ist nur zu beantworten, wenn man einen kleinen Ausflug in die Kognitions- bzw. Arbeitswissenschaften macht. Das NTSB unternahm einen derartigen Versuch jedenfalls nicht! Das ist umso bedauerlicher, da aussagefähige Unterlagen, Berichte und Aufzeichnungen zur Verfügung standen, aus denen die Handlungsregulierung des Lotsen klar zu rekonstruieren und nachzuweisen war. Durch den veränderten Charakter der Schiffsführung als Informationsverarbeitungsprozess tritt einerseits die Forderung nach adäquaten Untersuchungsmethoden immer stärker zu Tage.

Andererseits sind nachhaltige präventive Maßnahmen aus diesem Seeunfall nur dann abzuleiten, wenn die Regulationsgrundlagen für die Handlungen des Lotsen durchschaubar werden. Der Verfasser widmet sich nochmals diesem Fall, weil die angesprochene Problematik für die Ursachenermittlung und die Gestaltung von Schiffsführungssystemen hoch aktuell ist.

2. Zu einigen Aspekten der Handlungsregulation

Eine der wichtigsten Anforderungen im Schiffsführungsprozess bildet die Aufnahme, teilweise auch das Aufsuchen, die Verarbeitung und Nutzung eines sich ständig verändernden informationstragenden Reizstromes für die Tätigkeitsregulation. Die psychische Regulation von Handlungen umfasst die Teilfunktionen Erkennen, Bewerten, Entscheiden, Erleben, Streben, Kontrollieren und Behalten. Eine Handlung ist eine »zumeist komplexe Abfolge von koordinierten und umweltbezogenen Bewegungen eines Individuums im Sinne einer auf die Realisierung eines Ziels gerichteten, relativ geschlossenen, zeitlich und logisch strukturierten Tätigkeitseinheit«.*

Damit erfolgt die Handlungsregulation durch die Vorwegnahme des Resultates der Handlung, des Ablaufes der Tätigkeit und der für die Handlung wichtigen Bedingungen. Entsprechend erarbeitete Aktionsprogramme können als Handlungsplanung verstanden werden. Sie bilden das interne Modell des Operateurs, nach dem er seine Tätigkeit organisiert. Handlungen sind gedanklich vorweggenommen und auf die Erreichung gesteckter Ziele ausgerichtet.

Ein Reiz wird in diesem Zusammenhang als Träger von inhaltlichen Informationen betrachtet. Enthält er wichtige Steuerungsinformationen, aus denen ein Handeln abgeleitet werden kann, wird er zum handlungsrelevanten Signal. Das zieht z. B. ein erwartungsgebundenes Verhalten und die Herstellung des Zusammenhangs zwischen geplanter Aktion und Signal mit der Erfassung der Bedeutung des Signals nach sich. Signale werden zu Anzeigen für ein aufgabenspezifisches Handeln. Sie sind anschaulich gegebene oder in Urteilsprozessen erfasste Merkmale des Steuerungsprozesses, der auf diesen Prozess einwirkenden Tätigkeit oder auch subjektiver Zustände, die identifiziert werden und die in einer bestimmten Ausprägung eine spezifische Bedeutung mit spezieller notwendiger Handlungsanweisung für Prozesseingriffe beinhalten [4].

Bezüglich ihrer Wirkung auf die Handlungen des Operateurs kann in Haupt- und Nebeninformationen unterschieden werden. Während Hauptinformationen vorrangig handlungsbestimmend sind und der Aktionsorientierung dienen, hat eine Nebeninformation handlungsbestätigenden Charakter. Eine große Gefahr im Handlungs- und Entscheidungsprozess entsteht dann, wenn geplante Hauptinformationen zur falschen Zeit oder in der falschen Situation erscheinen. Das als Aktion gespeicherte und der Hauptinformation entsprechende Modell ist nur in seltenen Fällen änderbar. Auch die Nebeninformationen führen, selbst wenn sie die Hauptinformation nicht bestätigen und auf widersprüchliche Aktionen hinweisen, nicht zu einer Modelländerung. Eher besteht die Neigung, nur solche Nebeninformationen zu verwenden oder diese so zu interpretieren, dass sie die Hauptinformation und das entsprechend Aktionsmodell bestätigen, selbst wenn sie falsch sind. Besonders dramatisch erscheint die Tatsache, dass menschliches Versagen nicht vorrangig das Ergebnis von Nachlässigkeiten und schlechter Seemannschaft sein muss, sondern einem gesetzmäßig existierendem Ablauf kognitiver Vorgänge folgen kann, der in komplexen, dynamischen Abläufen nur sehr schwer oder gar nicht zu erkennen ist. Man hat diesem Sachverhalt die Bezeichnung »mangelhaftes Situationsbewusstsein« gegeben. Technische Lösungen verdecken durch mitunter faszinierende Farb- und Formgebungen sowie durch das die Leistungsfähigkeit des Menschen erschlagende Datenangebot die Mängel in der Verlässlichkeit von Mensch und Maschine in ihrer Gesamtheit.

»(…) Mit zunehmender Automatisierung einer Strategie nimmt die bewusste Steuerung und Kontrolle der Handlung ab, das strategische Vorgehen wird mehr und mehr zur reinen Routine mit reduzierter Beteiligung des Bewusstseins. (…) Bei einer Veränderung der Situationsbedingungen kann die Anwendung einer automatisierten Strategie zu einer völligen Verfehlung des Ziels führen. (…) Das strategische Vorgehen (wird) nicht mehr auf die spezifischen Bedingungen angepasst. (…) Die automatisierte Strategie kann unter veränderten Bedingungen inadäquat sein. Die Wahrscheinlichkeit von Fehlern (…) steigt an, da bei einer automatisierten Strategie zugunsten einer Reduzierung des kognitiven Aufwands die Situation und alternative Vorgehensweisen nur oberflächlich oder gar nicht analysiert werden. (…) Die Dynamik automatisierter Verhaltensweisen ist also nicht zu unterschätzen, da deren Auslösung und Durchführung nur in geringem Umfang bewusst kontrolliert werden kann. (…) Eine inadäquate automatisierte Strategie durch eine situationsangepasste andere Strategie zu ersetzen, bedarf eines aufwendigen kognitiven Prozesses, der auf intellektueller Ebene bewusst vollzogen werden muss (Verarbeitung der Feedbackinformationen, Reproduktion bekannter Regelsätze, Vergleich der aktuellen Situationsgegebenheiten mit den abgespeicherten ›Wenn-dann-Regeln‹, Auswahl eines situationsgerechten Regelsatzes, u. U. weitere Anpassung der ausgewählten Strategie an die Situation). (…) Unter belastenden Situationsbedingungen (bedarf es) zusätzlicher kognitiver Ressourcen (…), um ein situationsangemessenes strategisches Vorgehen anzuwenden.« (Hier zitiert nach: Zempel, J. [5])

Zu den folgenden Ausführungen siehe [1]:

»Fehlhandlungen werden sich in vielen Fällen aufgrund der Dynamik des Prozesses und seiner Zeitanforderungen nicht immer zeitgerecht und angemessen durch menschliche Handlungen und Handlungsregulation sowie entsprechende maschinelle Aktionen und Regelungsfunktionen auffangen und beheben lassen. So entstehen in Prozessführungssystemen ›Incidents‹ und auch ›Accidents‹ im Falle komplexer, nicht korrekt oder zeitgerecht regulierbarer Anomalien im Systembetrieb. Es unterstützt weder das Verständnis noch die Vermeidung solcher Ereignisse, diese nach ihrem Auftreten mit menschlichem oder technischem Versagen zu attributieren, solange die Ursache letztlich in einer fehlabgestimmten Mensch-Maschine-Schnittstelle, die die eingeschränkte sensorische Instrumentierung des Prozesses und andere begrenzte maschinelle Funktionen bzw. die physischen und psychischen Grenzen menschlicher Operateure nicht angemessen berücksichtigt.«

In diesem Seeunfall wurde ein Radarsignal als Orientierungshilfe bei der Ansteuerung der Brücke als handlungsregulierende Hauptinformation verwendet. Nebeninformationen sollten den darauf basierenden Handlungsplan bestätigen. Andere Hauptinformationen wurden nicht verwendet. Dadurch richtete sich die Bildung der Modelle ausschließlich am selektierten Ziel aus. Hier ›entartete‹ die Schwerpunktbildung und erschien unwideruflich. Der Lotse stellte eng strukturierte Hypothesen auf und war dann nicht mehr in der Lage, von diesen abzuweichen, unabhängig davon, ob sie eintrafen oder nicht. Informationen wurden nur noch danach ausgesucht, ob sie in das eingangs gefundene Modell hineinpassten oder nicht. Wenn sie nicht passten, wurden sie verworfen oder so interpretiert, dass sie ›passfertig‹ erschienen. Diese menschliche Eigenschaft ›Verdrängen des Unbehaglichen‹ ist die Ursache vieler Fehlhandlungen an Bord. Immer wieder erlebte Situationen mit etwa gleichen Eigenschaften (z. B. ein Schiff unter immer ähnlichen Bedingungen durch eine Brücke bringen), für deren Bewältigung Radarsignal, Electronic Bearing Line (EBL) und Variable Range Marker (VRM) stets erfolgreich waren, führen zu einer sehr vereinfachten und verallgemeinerten Modellbildung mit nicht weiter zu überprüfenden Problemlösungen. Diese Erfahrungen, im positiven Sinne ausgedrückt, bewähren sich sehr häufig und reduzieren den ›Denkaufwand‹. Sie bergen aber auch die Gefahr in sich, bei veränderten Bedingungen trotz widersprüchlicher Anzeichen angewendet zu werden. Erst bei funktionierender Rückkopplung wird bemerkt, dass in einem speziellen Fall (die Radaranzeigen sind fehlerhaft und die optische Sicht ist sehr gering) die bisherige, durch Erfahrung verallgemeinerte Lösung unwirksam ist oder zum Gegenteil führt (das Schiff wird durch die ›falsche Mitte‹ geführt).

Wunschdenken, Hoffnungen und Erwartungen sind tief in menschlicher Tätigkeit verwurzelt.

Nicht unerwartet sind sie die Quelle vieler Fehler, Irrtümer und Enttäuschungen. Menschen können die vor ihnen liegende Realität einschließlich ihres weiteren Verlaufes nur sehr bedingt objektiv einschätzen. Der Wunsch nach Bestätigung des eigenen Tuns und des soeben konstruierten Modells der Situation sind stark ausgeprägt. Wenn aber dieses Modell schon fehlerbehaftet ist, so können die davon bestimmten Hoffnungen oder die ›hineingedachten‹ Wünsche nicht richtig sein. Der Mut zur Handlungskorrektur verliert sich mit dem Grad der Faszination des Handelnden bezüglich der einsetzenden Wirkungsfolgen. Der Mensch will den Erfolg, will die Bestätigung seines Planes, schaut auf die Anzeigen seiner Geräte und wartet ab, ob sich alles so einstellt, wie er gedacht hat. Er ist der Dynamik der Veränderungen ausgesetzt, unterdrückt seine Zweifel, verstärkt seine Hoffnungen und Erwartungen. In dieser Phase des Handlungsprozesses werden kaum Korrekturen angebracht. Führt die Handlung letztlich zu einem Erfolg, bleibt sie als solche in Erinnerung, unabhängig davon, ob sie tatsächlich optimal war (Beobachtungs- und Handlungsstarre).

3. Die handlungsregulierende Wirkung von Informationen – ein praktisches Beispiel

Zur Beantwortung der Frage »… why did he choose to turn when he did?« werden zunächst die folgenden Aussagen gemacht:

1. Primäre Ursache für den Seeunfall war das Ausbleiben einer handlungsregulierenden Information in einem Zeitbereich, in dem ein Prozesseingriff notwendig und erfolgreich gewesen wäre (ca. 40–60 s oder etwa eine Schiffslänge früher).

2. Der Lotse verfügte über ein vorbereitetes mentales Modell des Handlungsablaufes und der die Handlungen auslösenden Informationen. Zwischen den aktuellen Anzeigen der im mentalen Modell abgespeicherten Informationen und den daraus abzuleitenden Handlungen verging eine nur geringe Reaktionszeit von wenigen Sekunden. Das deutet auf ein vorbereitetes, festes Handlungsmuster hin (Routine). Diese Routine hätte, wie in tausend anderen Fällen, den Erfolg gebracht, wenn das Signal erwartunggemäß erschienen wäre (entartete Schwerpunktbildung, enge Hypothesen).

3. In diesem Prozess mit hoher Komplexität verliefen die Zustands- und Bedingungsänderungen sehr dynamisch, so dass die objektiv vorhanden Leistungsgrenzen des Menschen die Adaption bzw. die Neubildung eines mentalen Modells verhinderten. Erschwerend kamen die relativ hohe Schiffsgeschwindigkeit und die natürlichen Bedingungen sowie eine fehlende Zusammenarbeit zwischen dem Lotsen und dem Kapitän hinzu.

4. Deshalb und wegen der Aussagen in den Punkten 2. und 3. blieb in der Zeit der fehlenden Anzeige des erwarteten Radarsignals ihre handlungsregulierende Wirkung erhalten und bestimmte sofort nach ihrem Erscheinen die Handlungen des Lotsen, obwohl sie nicht mehr der veränderten Situation (Position des Schiffes zur Brücke) entsprach.

5. Durch Rückverlagerung der handlungsregulierenden Information um die Zeitdifferenz ihres Nichterscheinens (40–60 s) muss nachgewiesen werden können, dass der tatsächliche Handlungsverlauf des Lotsen erfolgreich gewesen wäre und sich der positive Charakter eines routinemäßigen Verlaufes bestätigt hätte.

Nach dem Verlassen des Liegeplatzes konzentriert sich der Lotse auf die An- und Durchsteuerung der Brücke. Wie immer will er dazu routinemäßig das Racon-Signal »Y« benutzen, das die Mitte der Durchfahrt kennzeichnet (Hauptinformation, Abb. 1 und 3). Als Nebeninformationen dienen der Abstand zu Yerba Buena Island (VRM = 0,33 nm und die Richtungen der EBL). Bei der Annäherung an die Brücke kann er die Hauptinformation jedoch im Radar nicht ausmachen und versucht, sich im Electronic Chart Display (ECD) zu orientieren. Das aber gelingt ihm trotz Rückfrage beim Kapitän nicht und er lässt das Schiff weiter mit ca. 8–10 kn auf die Brücke zulaufen. Um 08:23:14 Uhr erscheint ganz kurz ein erwartetes Fragment des Hauptsignals und zusammen mit den Nebeninformationen VRM und EBL lösen diese Information eine sofortige Handlung aus: Kursänderung nach Backbord (BB). Das Schiff beginnt langsam zu drehen, während der Lotse die Radaranzeigen nach seinem erwarteten Hauptsignal absucht. Doch es erscheint nicht (beispielhaft Abb. 2).

Der Voice-Recorder gibt die Lage wie folgt wieder [2]:

08:23:21 PILOT: port ten; … 08:25:30 PILOT: midships. … 08:25:41 PILOT: two five – two five zero; … 08:25:50 PILOT: yeah make it two four five all right.

Das Schiff dreht weiter nach BB. Der Lotse wird unruhig und ordert »midships«. Er wartet auf seine Hauptinformation und fängt das Schiff bei einem Kurs von 245° ab.

Sein ursprüngliches Ziel, das Schiff mittels Racon-Signal »Y« durch die Mitte zu führen, ist fest als mentales Modell verankert. Er ist in dieser Situation nicht in der Lage, seinen Handlungsplan zu ändern und entspricht damit theoretisch objektiv existierenden menschlichen Eigenschaften.

Die Situation gleicht der Lage eines Autofahreres, der auf eine geschlossene Schranke zufährt und darauf wartet, dass das Öffnungssignal erscheint und sich die Schranke endlich und wie immer rechtzeitig vor ihm öffnet. Doch das geschieht hier bis zur 26. Minute nicht! Aber das Schiff wird nicht am Weiterfahren gehindert, die schiffseigenen Systeme reagieren nicht, eine Schutzfunktion ist nicht vorhanden, die menschliche Schwäche ist Systembestandteil und wird nicht entdeckt (vgl. [1]: »… die eingeschränkte sensorische Instrumentierung des Prozesses und andere begrenzte maschinelle Funktionen bzw. die physischen und psychischen Grenzen menschlicher Operateure nicht angemessen berücksichtigt.«)

Natürlich hätte man andere Informationsquellen einsetzen müssen, die den sich ständig ausweitenden Fehler sichtbar gemacht hätten. Die später vorgestellte Problemlösung »Assistenzsystem« führt genau diese Funktion aus und verhindert so die objektiv vorhandene Systemschwäche von Mensch und Maschine auf der »Cosco Busan«.

Endlich erscheint das erwartete Signal: das »Tor« öffnet sich (Abb. 3; 08:26:14 Uhr). Diese Information reguliert sein Handeln. Der Plan erfüllt sich. Die Theorie wird bestätigt: »(…) da bei einer automatisierten Strategie zugunsten einer Reduzierung des kognitiven Aufwands die Situation und alternative Vorgehensweisen nur oberflächlich oder gar nicht analysiert werden(…)« [5]. Also macht der Lotse das, was er immer gemacht hat: auf die »Mitte zuhalten«. Der Voice-Recorder gibt den Ablauf wieder [2]:

08:26:23 PILOT: starboard ten; … 08:26:37 PILOT: starboard twenty; … 08:26:54 PILOT: full ahead.

Das Schiff dreht zügig an. Zu einer kritischen Prüfung von Handlungsziel und Handlungsbedingungen ist der Lotse in dieser ›Handlungshochphase‹ nicht mehr fähig. Hohe Komplexität und Dynamik des Prozesses schließen derartige ›vernünftige‹ Überlegungen aus. Er erkennt nicht mehr, dass die Drehung des Schiffes nach Steuerbord wahrscheinlich in einer Phase der Handlungsstarre (während des Wartens auf das Racon-Signal) um ca. 40–60 s oder etwa eine Schiffslänge zu spät eingeleitet wurde (vergl. Abb. 4). Erschwerend kommt in dieser Phase der Bestätigung seines Handlungsplanes ca. 30 s nach »full ahead« eine hochwirksame Störung bzw. Ablenkung durch eine Anfrage der VTS-Zentrale [2] hinzu:

08:27:24 VTS: unit romeo traffic; 08:27:29 PILOT VHF: traffic romeo; 08:27:37 PILOT: ease to ten; 08:27:45 PILOT VHF: traffic romeo did you call?; 08:27:48 VTS: unit romeo traffic the AIS shows you on two three five heading what are your intentions over?; 08:27:57 PILOT VHF: well I’m comin’ around I’m steering two eighty right now; 08:28:02 PILOT: starboard twenty.

Mit »ease to ten« verzögert er die so notwendige aber zu spät eingeleitete Drehung des Schiffes nach Steuerbord. Die Versuche, die Mitte der Durchfahrt im ECD zu finden und den Kapitän zu befragen sowie die Verwirrungen, die durch weitere, nicht definierte Signale ausgelöst werden, weisen auf den Verlust der Handlungskompetenz des Lotsen hin.

Gefahren wachsen nicht linear und kontinuierlich, sondern dynamisch, sprunghaft, exponentiell und zufällig. Man kann viele Ursachen für das Versagen von Lotse und Kapitän der »Cosco Busan« finden und viele werden zu Recht genannt. Es nutzt der Praxis und den Herstellern allerdings wenig, wenn die Zusammenhänge von menschlichen Eigenschaften und technischen Systemen nicht in den Brennpunkt von Entwicklungen gestellt werden. Geräte können nicht ›exzellent‹ sein, wenn durch ihren Gebrauch der Mensch versagt. Der Zusammenhang zwischen kognitiven Prozessen bei der Informationsverarbeitung und den ausgelösten Vorgängen bei der Handlungsregulation ist in diesem Fall offenkundig.

4. Eine Problemlösung

Es ist naheliegend, die Qualität der Steuerungsprozesse über die messbaren Eigenschaften von Daten, Signalen und Informationen zum Ausdruck zu bringen, wenn man über geeignete Mittel zur Erfassung, Strukturierung und Bewertung verfügt (vgl. [9], [10], [11]).

Die mentale Abbildung des Prozessgeschehens wird durch eine Reihe von Störgrößen beeinflusst. Letztlich dient die Prozessabbildung (die Situationsanalyse) dem Kapitän dazu, die Höhe der Gefahr für die Erfüllung der Schiffsführungsaufgaben zum Ausdruck zu bringen. Am Ende des kognitiven Vorganges wird die Situation so abgebildet, wie sie den Möglichkeiten und Zielvorstellungen des Menschen entspricht, unabhängig davon, ob sie tatsächlich in der wahrgenommenen Weise existiert oder nicht. Diese ›Schwäche‹ hat ein Assistenzsystem nicht. Die Eingangsgrößen werden über entsprechende Schnittstellen dem Schiffsführungsprozess entnommen und dem Assistenzsystem zugeführt. Bei diesem Seeunfall wurden die erforderlichen Daten den aufgezeichneten Radarbildern, den Angaben des Seegebietes und den Informationen über das Schiff selbst entnommen und für die Rekonstruktion verwendet (vgl. Abb. 5).

Wichtige Eingangsdaten für die Gefahrenberechnungen sind:

• Betriebszustand;

• Komplexitätsfaktor für Manövriereigenschaften, Manövriercharakteristik;

• Sensibilitätsfaktor für die Berechnung der Höhe der Gefahr bei bestimmten Bedingungen;

• erlaubte Querabweichung von der Bahn;

• safety contour, einzuhaltende Wassertiefe unter dem Kiel, Wassertiefe, Tiefgang;

• Under Keel Clearance (UKCL);

• Größe des mindestens verfügbaren Manövriergebietes;

• Wellenhöhe, Krängungswinkel;

• Grundbeschaffenheit;

• Kurs und Geschwindigkeit.

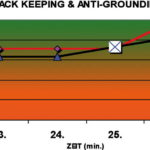

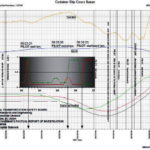

In Abb. 6 sind die Höhen der aus den spezifischen Eingangsgrößen berechneten Gefahren für die Erfüllung der partiellen Aufgaben »track keeping« und »anti-grounding« für die Situationsfolgen zwischen der 22. und 27. Minute dargestellt, unabhängig vom Willen, von Emotionen, von Empfindungen, von augenblicklichen Leistungseigenschaften des Menschen. Jeder der berechneten Punkte wird durch eine detaillierte Analyse der Ursachen und der Einflussgrößen ergänzt. Das Assistenzsystem kommt für den Zeitpunkt 08:26 Uhr zu folgendem Ergebnis:

Track Keeping: Height of danger: 1.0 accident; serious lack of quality; Process Character: Complexity: 5.35 (high); Controllability: 5.0; Process Time: 20 s

Details: track limit both port & starboard: 100 m ; cross track error: 94 m ; safety contour: 15 m ; depth below transducer: 3 m; available manoeuvring area: 510 m ; needed manoeuvring area: 2653 m ; limit of under keel clearance: 1.5 m ; speed (log): 10.1 kn; recent stop way: 1985 m; Ratio xtd/TRL (Track Line): 94 %; ratio needed / available manoeuvring area: 520.2 %; ratio depth below transducer + UKCl/max draft: 22.2 %

Erläuterung: Die Werte geben an, in welchem Verhältnis sich der aktuelle Zustand zu den aktuell vorgefundenen Bedingungen befindet. Die Verhältnisgrößen werden den Wissensbasen zugeführt und dort hinsichtlich ihrer Zugehörigkeitsfunktion klassifiziert. Die Höhe der Gefahr für die Erfüllung einer partiellen Schiffsführungsaufgabe in ihrer Gesamtheit wird davon bestimmt, wie groß die von jedem Eingangsparameter ausgehende Gefahr ist (Ursachen). Der numerische Wert geht bei Überschreitung eines Grenzwertes in die Berechnung des Prozesscharakters ein. Eine qualitative Bewertung folgt.

Causes: ratio xtd/TRL: 190 % high dangerous xtd; ratio needed / avail manoeuvring area: 190 % high dangerous manoeuvring area; ratio depth below transducer + UKCl / max draft: 190 % high dangerous depth / draft

Das Assistenzsystem kommt zu der folgenden Schlussfolgerung:

Die Erfüllung der Schiffsführungsaufgabe »track keeping« ist um 08:26 Uhr außerordentlich stark gefährdet (Accident). Ursächlich für die augenblickliche Situation sind die Größe der Bahnabweichung, das stark begrenzte Manövergebiet und die geringe Bodenfreiheit.

Recommendation: »emergency manoeuvre for improving track situation!« Anti-Grounding: Height of danger: 0.8 high danger; serious lack of quality; Process character: Complexity: 3.06 (high); Controllability: 3.13; Process time: 7 s

Details: available manoeuvring area: 510 m; needed manoeuvring area: 2653.88 m; safety contour: 15 m; depth under keel: 3 m; limit of under keel clearance: 1.5 m; speed (log): 10.1 kn; recent stop way: 1985 m; condition of bottom: hard sand resp. rocks.

ratio recent / possible speed in available manoeuvring area: 420.8 %; ratio total draft increase / depth below transducer: 50.3 %; ratio recent / critical speed (due squat): 56.5 %; ship trims bow – heavy; squat bow: 0.09 m; squat stern: 0.08 m; additional deduction: bottom -0.71 m; heeling -0.34 m; waves -0.37 m; total deduction: 1.51 m: recent under keel clearance: 1.5 m

Causes: ratio recent / possible speed in available manoeuvring area: 190 % high dangerous speed in manoeuvring area; ratio total draft increase / depth below transducer: 180 % high dangerous draft increase; ratio recent / critical speed (due squat): 40 % no speed risk due squat

Das Assistenzsystem kommt zu der Schlussfolgerung: Die Erfüllung der Schiffsführungsaufgabe »Anti-grounding« ist um 08:26 Uhr in hoher Gefahr (High Danger). Ursächlich für die augenblickliche Situation sind die Höhe der Geschwindigkeit im verfügbaren Manövergebiet und die Tiefgangszunahme. Wegen des guten Verhältnisses von aktueller zu kritischer Geschwindigkeit besteht keine Gefahr durch Squat.

Recommendation: »possible speed (speedmax) in restricted manoeuvring area should be speedmax = 2.5 kts«, possible speed in restricted man. area: 2.5 kn; critical speed (due squat) in shallow waters: 17.9 kn; max. recom. speed (due squat) in shallow waters: 8.9 kn.

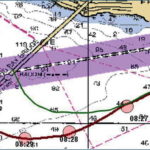

In den Abb. 7 und 8 werden beispielhaft die handlungsregulierenden Informationen aus diesen partiellen Schiffsführungsaufgaben angeboten, die unabhängig von den Radaranzeigen rechtzeitig auf die bevorstehenden Probleme aufmerksam gemacht hätten. Auf Abb. 7 befinden sich beide Prozesse noch im gelben Bereich etwa sieben Minuten vor der Berührung des Pfeilers. Die Aussage in Abb. 8 (»roter Bereich«) ist insofern sehr wichtig, weil hier die Kursänderung nach Steuerbord nicht mehr hätte eingeleitet werden dürfen. Die Priorität des ursprünglich erwarteten und um 08:26:14 Uhr erscheinenden Racon-Signals wäre durch die höhere Priorität der Gefahr für das Schiff durch Bahnabweichung und Grundberührung abgelöst worden und hätte das Handeln des Lotsen bestimmen müssen.

5. Schlussanmerkung

Die in diesem Seeunfall zu beobachtende ›Handlungsstarre‹ des Lotsen muss als typische Erscheinung handlungsregulierender Vorgänge erkannt und begründet werden, um zu verstehen, warum der Lotse an einer Stelle (zu einem Zeitpunkt) die Kursänderungen des Schiffes orderte. Die Zusammenhänge zwischen auftretenden Signalen und Aktionen des Lotsen sind klar nachweisbar. Der Lotse handelte nicht unvorbereitet und konfus, sondern nach gelernten Routinen. Das kann auch durch die Rückverlagerung der handlungsregulierenden Information um die Zeitdifferenz ihres Nichterscheinens (40–60 s) und eine dann beginnende gleiche Handlungsfolge (Manöverablauf) nachgewiesen werden. In Abb. 9 ist dieser Weg grün gekennzeichnet. Wegabschnitte und Vorausrichtungen wurden übernommen. Das Schiff passiert die Brücke in der Mitte zwischen den beiden Pfeilern »E« und »D«, exakt unter dem Radarsignal »Y«.

Durch das Warten auf das handlungsregulierende Signal verging kostbare Zeit, die den Einsatz dieser Routinen in Verbindung mit Hoffnungen und Erwartungen verzögerte. Die innere Logik gleicher oder ähnlicher Handlungsabläufe weist auf die Notwendigkeit von Rückkopplungen zu partiellen Aufgabenstellungen der Schiffsführung (hier insbesondere der Bahnführung) hin, da nicht allein an der Übereinstimmung von geplantem und tatsächlichem Handlungsablauf der Erfolg in der Zielerreichung abgeschätzt werden kann. Zum Erfolg gehört notwendigerweise der richtige Zeitpunkt des Prozesseingriffes. In der Regel ist es sinnvoll, die Rückkopplung über ein zweites, von der ersten Methode unabhängiges Verfahren zu ermöglichen.

Die hohe Wirkungskraft der festen ›inneren‹ Bindung des Menschen an die Reiz- und Signalwelt seiner Umgebung und die Suche nach bestätigenden Merkmalen führt u. U. in die Katastrophe. Ein verlässliches System beachtet diese Gesetzmäßigkeit und versucht vorausschauend, dort Assistenz zu geben, wo das Auftreten menschlicher Fehler wahrscheinlich ist.

Diethard Kersandt